Grace, una CPU estrechamente integrada para modelos de IA de más de un billón de parámetros, es el resultado de 10.000 años de trabajo de ingeniería.

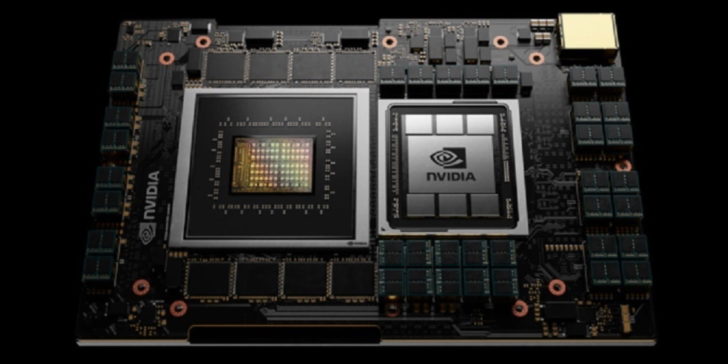

NVIDIA ha presentado hoy su procesador Grace. Se trata de una unidad central de procesamiento (CPU) basada en ARM para aplicaciones de inteligencia artificial y computación de alto rendimiento a escala gigante.

Se trata de la primera CPU para centros de datos de NVIDIA, creada específicamente para aplicaciones que funcionan a escala masiva, según ha afirmado el CEO de NVIDIA, Jensen Huang, en un discurso de presentación en el evento GTC 2021 de NVIDIA. Huang subrayó que “es la primera CPU del mundo diseñada para la computación a escala de terabytes”.

Grace ofrece un salto de rendimiento 10 veces mayor para los sistemas que entrenan modelos gigantes de IA, utilizando núcleos ARM de bajo consumo. Además, NVIDIA ha dicho que el Centro de Supercomputación de Suiza y el Laboratorio Nacional de Los Álamos del Departamento de Energía de EE.UU. serán los primeros en utilizar Grace, que lleva el nombre de Grace Hopper, pionera de la programación informática en la década de 1950. Se espera que la CPU esté disponible a principios de 2023.

“Grace es una CPU innovadora. Está diseñada para aplicaciones de computación acelerada a gran escala para IA y HPC”, dijo Paresh Kharya, director senior de gestión de productos y marketing de NVIDIA, en una rueda de prensa.

La CPU es el resultado de más de 10.000 años de trabajo de ingeniería. NVIDIA afirma que el chip responderá a las necesidades de computación de las aplicaciones más avanzadas del mundo -como el procesamiento del lenguaje natural, los sistemas de recomendación y la supercomputación de IA- que analizan enormes conjuntos de datos que requieren un rendimiento de computación ultrarrápido y una memoria masiva.

Grace combina núcleos de CPU ARM de bajo consumo con un innovador subsistema de memoria de bajo consumo para ofrecer un alto rendimiento con gran eficiencia. El chip utilizará un futuro núcleo ARM denominado Neoverse.

“La IA y la ciencia de los datos de vanguardia están llevando la arquitectura de los ordenadores actuales más allá de sus límites, procesando cantidades impensables de datos”, dijo Huang en su discurso. “Utilizando la IP de ARM bajo licencia, NVIDIA ha diseñado Grace como una CPU específica para la IA y la HPC a escala gigante. Junto con la GPU y la DPU, Grace nos proporciona la tercera tecnología fundamental para la computación y la capacidad de rediseñar el centro de datos para hacer avanzar la IA. NVIDIA es ahora una compañía de tres chips”.

Grace es un procesador altamente especializado dirigido a cargas de trabajo como el entrenamiento de modelos de PNL de nueva generación que tienen más de un billón de parámetros. Si se combina con las GPU de NVIDIA, un sistema basado en Grace ofrecerá un rendimiento 10 veces superior al de los sistemas actuales basados en NVIDIA DGX, que se ejecutan en CPU x86. En una rueda de prensa, alguien preguntó si NVIDIA competirá con los chips x86 de Intel y AMD.

Kharya dijo: “No estamos compitiendo con x86… seguimos trabajando muy bien con las CPU x86”. Grace está diseñado para aplicaciones de IA y HPC, pero NVIDIA no revela información adicional sobre dónde se utilizará Grace en la actualidad. NVIDIA tampoco ha querido revelar el número de transistores del chip Grace.

NVIDIA presenta Grace en un momento en que el volumen de datos y el tamaño de los modelos de IA crecen exponencialmente. Los mayores modelos de IA actuales incluyen miles de millones de parámetros y se duplican cada dos meses y medio. Para entrenarlos se necesita una nueva CPU que pueda acoplarse estrechamente a una GPU para eliminar los cuellos de botella del sistema.

La base del rendimiento de Grace es la tecnología de interconexión NVIDIA NVLink de cuarta generación, que proporciona conexiones de 900 gigabytes por segundo entre Grace y las unidades de procesamiento gráfico (GPU) de NVIDIA para permitir un ancho de banda agregado 30 veces mayor en comparación con los principales servidores actuales.

Grace también utilizará un innovador subsistema de memoria LPDDR5x que proporcionará el doble de ancho de banda y una eficiencia energética 10 veces mayor en comparación con la memoria DDR4. Además, la nueva arquitectura proporciona una coherencia de caché unificada con un único espacio de direcciones de memoria, combinando la memoria del sistema y de la GPU HBM para simplificar la programación.